实验室在计算成像方向的研究工作被被信号处理领域顶级刊物JSTSP录用,论文题目为“Efficient Video Representation via Hybrid Key Frame Reconstruction: A Test-time Data Augmentation Approach”。该论文第一作者为实验室负责人吉林大学副教授胡俊成,通讯作者为吉林大学助理研究员吕克敌,主要合作者包括清华大学电子系教授陈宏伟、北京清智元视科技有限公司黄泓皓博士和实验室22级卓班本科生冯玉琪。

研究背景

动态编码时域压缩成像中的视频重建,是计算成像与计算机视觉交叉领域的核心任务,广泛应用于安防监控、自动驾驶等安全关键场景。其核心目标是通过压缩测量数据精准还原高质量视频,同时保障结果的可信度与可靠性。然而,现有方法存在两大关键瓶颈:1)数据获取局限:传统单模态采样架构难以平衡时间分辨率与空间细节,长曝光压缩帧易丢失静态特征,短曝光帧则难以捕捉运动信息,导致重建视频存在细节模糊或运动失真问题;2)不确定性缺失:深度学习模型的确定性输出缺乏置信度量化机制,在复杂纹理区域(如边缘过渡、文本元素)易产生未知误差,给高风险场景应用带来安全隐患。为破解上述难题,团队提出融合测试时数据增强的混合关键帧辅助压缩视频重建方案,通过采样架构创新与网络设计优化,实现视频重建质量与不确定性量化的双重提升。

实验设计

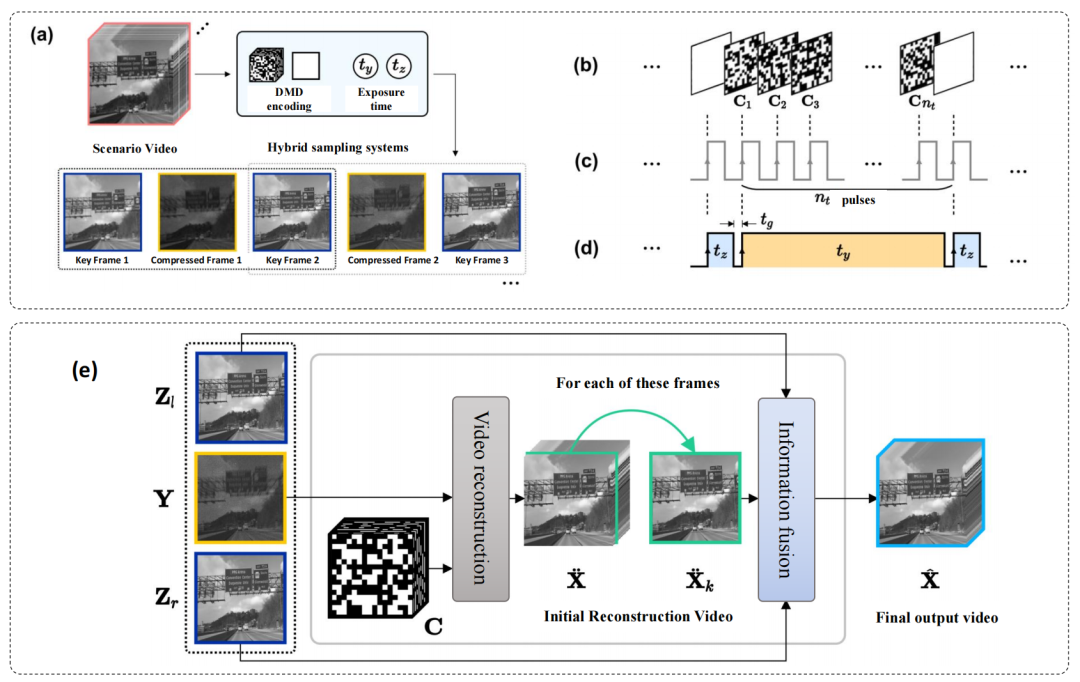

论文提出的 KH-TTA(Key Frames Assisted Hybrid Compressive Video Reconstruction with Test-time Data Augmentation)框架,是一套模型无关的高效视频重建解决方案,核心通过三大创新模块协同突破传统方法局限:1)双模态采样架构:同步捕捉长曝光压缩帧与短曝光关键帧,前者提供完整运动信息,后者保留高精度空间细节,通过互补数据输入解决单模态采样的固有 trade-off;2)时空变换测试时增强:设计符合成像物理约束的时空变换策略(包括空间翻转、90°整数倍旋转等),通过蒙特卡洛近似对后验分布采样,实现重建结果的统计融合与不确定性量化,无需修改原有模型结构;3)深度展开重建网络:基于8阶段迭代优化框架,集成特征共享去噪先验与时空对齐机制,增强模型对不同编码方案的适应性,提升跨场景泛化能力。同时,框架通过亮度线性缩放与双阶段融合策略,进一步优化关键帧与压缩帧的信息协同,有效抑制重建伪影。

实验结果

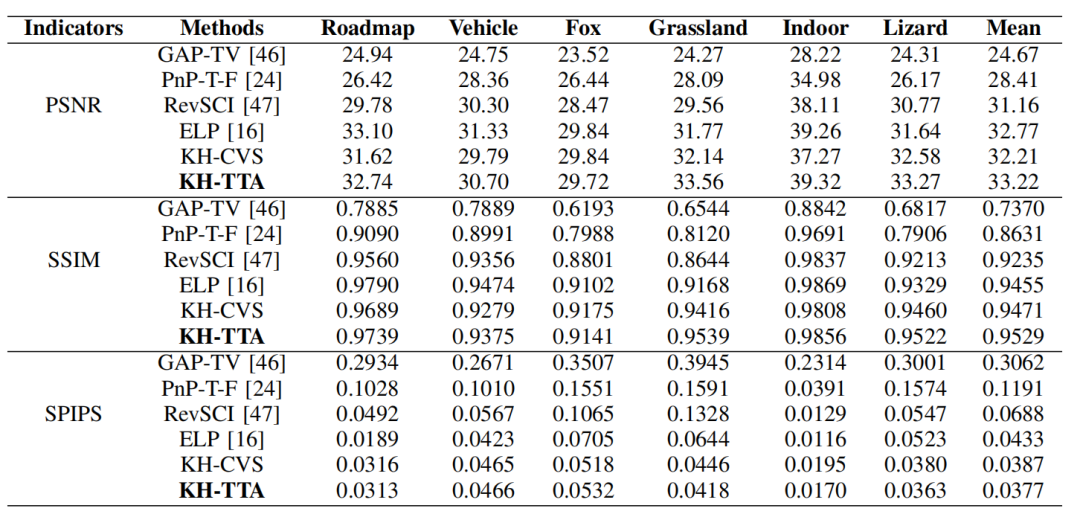

团队在模拟数据集与真实硬件系统中,将 KH-TTA 与 GAP-TV、RevSCI、ELP 等当前主流 SOTA 方法展开全面对比,实验基于 PyTorch 框架与高性能计算硬件,以 PSNR(峰值信噪比)、SSIM(结构相似性)、LPIPS(感知相似度)为核心评估指标,覆盖道路标识、车辆、生物等多类场景。结果显示,KH-TTA 在各项指标上均实现显著突破:平均 PSNR 较现有最优方法提升0.45-1.01 dB,SSIM提升0.0074,LPIPS降低12.9%,在复杂纹理区域的重建细节更清晰、伪影更少。同时,其不确定性量化机制表现出极高可靠性,重建误差与标准差的相关系数达0.85,硬件实验验证 R² 值为0.7194,可精准映射视觉误差分布。在长时效重建任务中,该方法仍能保持稳定性能,为动态场景下的高质量视频还原提供了有效解决方案。

JSTSP全称为IEEE Journal on Selected Topics in Signal Processing,是IEEE信号处理学会(IEEE Signal Processing Society)旗下的旗舰期刊,专注于发表信号处理领域的前沿研究。其最新影响因子为13.7,在信号处理领域长期保持顶尖学术影响力。